Formación académica

Estudió ingeniería en Michigan y se especializó en MIT, donde su tesis de maestría conectó lógica booleana y circuitos eléctricos.

Esa tesis es considerada uno de los trabajos más influyentes en la historia de la ingeniería.

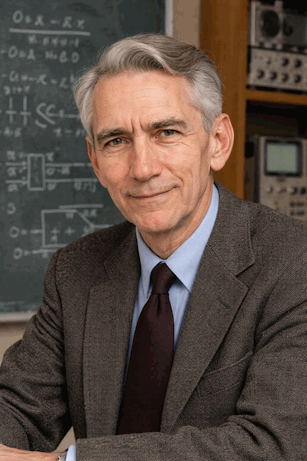

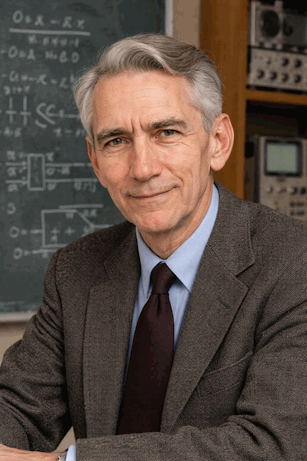

Personaje #8 · Teoría

1916–2001 · Ingeniero y matemático · Estados Unidos

Fundó la teoría de la información moderna y demostró que los circuitos eléctricos podían modelar operaciones lógicas. Su trabajo unió matemáticas, comunicación y computación, definiendo conceptos como bits, entropía y capacidad de canal, esenciales para internet, compresión y criptografía.

Ficha esencial

Un resumen para entender su impacto en la era digital.

Definió la medida de información, el bit y los límites de transmisión en canales.

A Mathematical Theory of Communication (1948).

Aplicó álgebra booleana al diseño de circuitos eléctricos.

Bell Labs, centro neurálgico de innovación tecnológica.

Biografía

Shannon combinó ingeniería eléctrica con matemática pura. Su capacidad para formalizar la información como un objeto matemático cambió para siempre la comunicación digital.

Estudió ingeniería en Michigan y se especializó en MIT, donde su tesis de maestría conectó lógica booleana y circuitos eléctricos.

Esa tesis es considerada uno de los trabajos más influyentes en la historia de la ingeniería.

En Bell Labs investigó sistemas de comunicación, telemetría y criptografía. Allí desarrolló su teoría de la información, definiendo el bit como unidad básica.

Sus ideas permitieron cuantificar la información y establecer límites de compresión y transmisión.

Shannon propuso que la información podía medirse en unidades discretas. Su modelo probabilístico permitió entender ruido, redundancia y optimización de señales.

Este concepto es el fundamento de la informática moderna y las telecomunicaciones digitales.

Aportes clave

Shannon definió los límites teóricos de la comunicación y estableció herramientas para diseñar sistemas eficientes de transmisión de datos.

Introdujo la entropía de información como medida de incertidumbre.

Demostró el límite máximo de datos que se pueden transmitir sin error.

Explicó cómo la redundancia permite corregir errores y mejorar la comunicación.

Su tesis aplicó álgebra booleana al diseño de circuitos digitales.

Cronología

Una línea de tiempo para ubicar su influencia histórica.

Desarrolla interés temprano en ingeniería y matemáticas.

Demuestra que lógica booleana puede implementarse con relés.

Define bits, entropía y capacidad de canal.

Su teoría se convierte en estándar de telecomunicaciones y computación.

Su legado permanece en cada transmisión digital moderna.

Entorno e instituciones

Shannon se movió en un laboratorio que reunía a los mejores científicos e ingenieros del siglo XX.

Allí coincidió con inventores del transistor y la telefonía moderna, creando un entorno de innovación sin precedentes.

Su formación en MIT le dio la base matemática necesaria para formalizar la información.

Sus ideas fueron adoptadas por ingenieros eléctricos, matemáticos y pioneros de la informática.

Legado

La teoría de la información se encuentra en compresión de datos, redes, criptografía y almacenamiento moderno.

Los algoritmos de compresión se basan en su concepto de entropía.

La capacidad de canal define límites para Wi-Fi, fibra óptica y satélites.

Sus estudios sobre comunicaciones seguras influyen en la seguridad moderna.

“La información es algo que reduce la incertidumbre.” — Claude Shannon (paráfrasis)

Para profundizar

Su teoría explica desde los emojis que viajan por internet hasta la transmisión de datos en misiones espaciales.

La unidad mínima de información digital, base de todos los sistemas de cómputo.

Entender la entropía permite reducir tamaño de archivos sin perder calidad.

Explica por qué hay límites en la velocidad de transmisión de datos.